特征向量(特征值和特征向量)

特征向量(特征值和特征向量),哪吒游戏网给大家带来详细的特征向量(特征值和特征向量)介绍,大家可以阅读一下,希望这篇特征向量(特征值和特征向量)可以给你带来参考价值。

特征值与特征向量的英文是 eigenvalue 和 eigenvector, 这个前缀 eigen- 起源于德语,意思是 proper(这里应该是专属的意思)、characteristic(特征的),其实翻译成’特征‘是很好的翻法。

我们先来理解这个为什么叫特征值和特征向量:

矩阵A当然是一个变换,然后这个变换的特殊之处是当它作用在特征向量

上的时候,

只发生了缩放变换,它的方向并没有改变,并没有旋转。

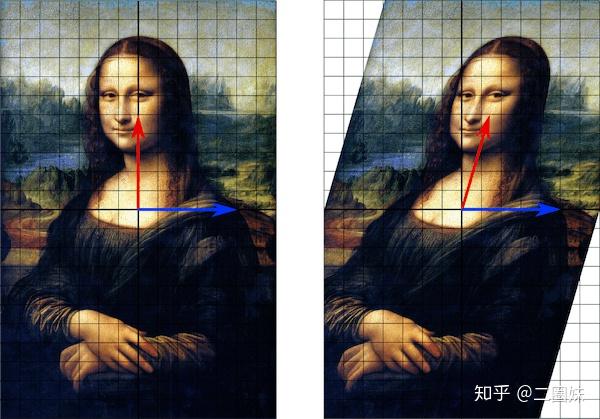

就像 wikipedia 上经过了错切变换的蒙娜丽莎一样:

这幅图片在水平方向没有改变,

就是一个它的特征向量,对应的特征值是 λ = 1 .

特征向量是经过了变换特征向量,这个向量可能会 scale, 但是仍旧保持其原有的方向,与特定的特征值对应。所以特征向量某种意义上展示了这个变换的‘特征’。

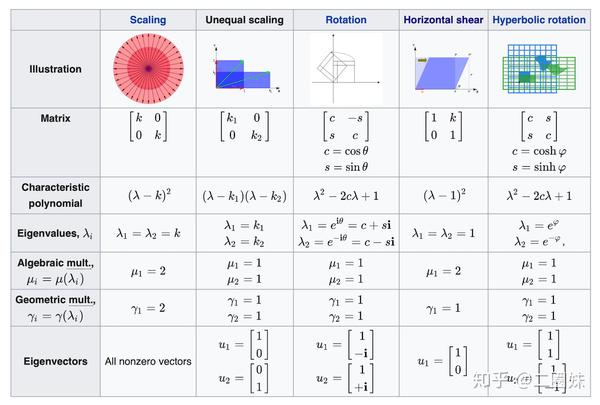

查看wikipedia上的这个表,一些常见的变换对应的特征向量:

那么根据这个图可以得到的结论有:

性质

一般来说对于一个 n x n 的矩阵,我们有:

可能有 n 个 对应的特征值和与之对应的特征向量,注意这里的用词‘可能’。因为看上表就知道这只是一种可能情况,那么我们根据这个可以推出许多别的性质:

也就是

特征值为

,特征向量跟A相同,还可以继续推出:

这个也很容易推出,同时这里我们可能会想要注意

,但实际上如果λ = 0,那就是

, A不可逆,我们也不想要继续这样推导

上面这个式子的推导还是用我们的老朋友,泰勒展开:

实际上最早特征值和特征向量就是为了解决微分方程出现的。

那么如果我们的这个 n x n 矩阵有 n 个特征向量,我们当然就可以用它来做一组基,可以把空间中任何向量写成:

相似矩阵

如果一个矩阵B可以表示成A的这个形式

,那么我们说 B 和 A 相似,相似矩阵会有相同的 特征值。

一个简单的看法是:

两边同时乘以M:

所以:

所以B和A的特征值相同,当然从上面这个式子可以看出来特征向量是不同的。

BA 和 AB 有相同的特征值,有了上面的结论,那么我们只用说明 BA 和 AB 相似就能解决问题:

取 M = B 即可得,当然这也说明了 B 要可逆才行。

矩阵的迹和行列式

矩阵的迹等于特征向量的和:

矩阵的行列式等于特征向量的积:

特征分解

继续一般的 n x n 矩阵,它可以分解成:

其中 Q 是 n×n 方阵特征向量,且其第 i列为 A 的特征向量

, Λ 是对角矩阵,其对角线上的元素为对应的特征值,也即

。只有可对角化矩阵才可以作特征分解。不能被对角化的矩阵当然也就不能特征分解。

这样分解之后,比如我们要计算:

而对于 n x n实对称矩阵,有 n 个线性无关的特征向量。并且这些特征向量都可以正交单位化而得到一组正交且模为 1 的向量。故实对称矩阵 A 可被分解成

以上结论也就是 spectral theorem.

参考:

总结:以上内容就是针对特征向量(特征值和特征向量)详细阐释,如果您觉得有更好的建议可以提供给哪吒游戏网小编,特征向量(特征值和特征向量)部分内容转载自互联网,有帮助可以收藏一下。